اس بلاگ میں، ہم ذیل میں فراہم کردہ مواد کا احاطہ کریں گے:

- ٹرانسفارمرز سے 'پائپ لائن' فنکشن کے ساتھ ماڈل لوڈ کر کے ٹیکسٹ جنریشن کو کس طرح کسٹمائز کیا جائے؟

- PyTorch میں متن پیدا کرنے کے لیے ٹرانسفارمر پر مبنی ماڈل کا استعمال کیسے کریں؟

- TensorFlow میں ٹیکسٹ بنانے کے لیے ٹرانسفارمر پر مبنی ماڈل کا استعمال کیسے کریں؟

ٹرانسفارمرز سے 'پائپ لائن' فنکشن کے ساتھ ماڈل لوڈ کر کے ٹیکسٹ جنریشن کو کس طرح اپنی مرضی کے مطابق بنایا جائے؟

' پائپ لائن ” فنکشن کا استعمال صارف کی ضروریات کے مطابق پہلے سے تربیت یافتہ AI ماڈل کو خود بخود ڈاؤن لوڈ کرنے کے لیے کیا جاتا ہے۔ اس خاص فنکشن کو استعمال کرنے کے لیے، صارفین کو انسٹال کرنا ہوگا ' ٹرانسفارمرز 'پیکیجز. یہ پیکیج جدید ترین ٹرانسفارمر پر مبنی ماڈلز تک رسائی فراہم کرتا ہے جو جذبات کا تجزیہ کرنے کے ساتھ ساتھ متعدد دیگر قدرتی زبان پروسیسنگ (NLP) کام

اوپر بیان کردہ منظر نامے کے عملی مظاہرے کو دیکھنے کے لیے، نیچے دیے گئے مراحل پر جائیں!

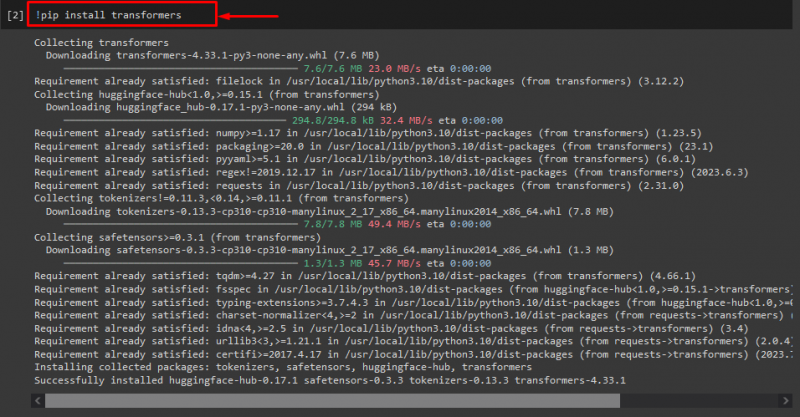

مرحلہ 1: 'ٹرانسفارمرز' پیکجز انسٹال کریں۔

ابتدائی طور پر، '! pip' ٹرانسفارمر پیکجوں کو انسٹال کرنے کا حکم:

! پائپ انسٹال ٹرانسفارمرز

جیسا کہ آپ دیکھ سکتے ہیں، مخصوص پیکج کامیابی سے انسٹال ہو گیا ہے:

مرحلہ 2: ٹرانسفارمر پر مبنی ماڈل درآمد کریں۔

اس کے بعد، مطلوبہ ٹرانسفارمر پر مبنی ماڈل درآمد کریں۔ ایسا کرنے کے لیے، پہلے، درآمد کریں ' پائپ لائن ' فنکشن ' سے ٹرانسفارمرز ' اگلا، درآمد شدہ فنکشن کا استعمال کریں اور پاس کریں ' ٹیکسٹ جنریشن 'اس کی دلیل کے طور پر مطلوبہ ماڈل نام کے ساتھ' gpt2 ' اگلا، انہیں ' پیدا کرنا متغیر:

سے ٹرانسفارمرز درآمد پائپ لائن

پیدا کرنا = پائپ لائن ( ٹیکسٹ جنریشن , ماڈل = 'gpt2' )

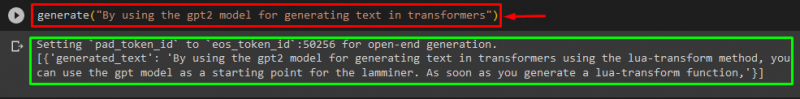

مرحلہ 3: حسب ضرورت متن تیار کریں۔

اب، مطلوبہ متن کو دلیل کے طور پر پاس کریں ' پیدا کرنا ' جیسا کہ نیچے دکھایا گیا ہے:

پیدا کرنا ( 'ٹرانسفارمرز میں متن پیدا کرنے کے لیے gpt2 ماڈل کا استعمال کرتے ہوئے' )فراہم کردہ آؤٹ پٹ کے مطابق، ڈاؤن لوڈ شدہ پہلے سے تربیت یافتہ ' gpt3 ماڈل کامیابی کے ساتھ متن تیار کیا گیا ہے:

آپ دوسرے دلائل بھی استعمال کر سکتے ہیں، جیسے:

فوری طور پر = 'ٹرانسفارمرز میں متن بنانے کے لیے gpt2 ماڈل کا استعمال کرتے ہوئے'پرنٹ کریں ( جین ( فوری طور پر ، num_return_sequences = 5 ، زیادہ سے زیادہ طوالت = بیس ) )

یہاں:

- ' فوری طور پر ” کو ایک دلیل کے طور پر استعمال کیا جاتا ہے جو ان پٹ کو رکھتا ہے۔

- ' num_return_sequence دلیل کا استعمال فراہم کردہ متن کی ترتیب کی تعداد پیدا کرنے کے لیے کیا جاتا ہے۔

- ' زیادہ سے زیادہ طوالت ' استدلال کو تیار کردہ متن کی لمبائی بتانے کے لیے استعمال کیا جاتا ہے۔ ہمارے معاملے میں، یہ محدود ہے ' 30 ٹوکن (الفاظ یا اوقاف):

نوٹ: حسب ضرورت متن مخصوص پرامپٹ کا تسلسل ہو گا جو ماڈل کے تربیتی ڈیٹا پر مبنی ہے۔

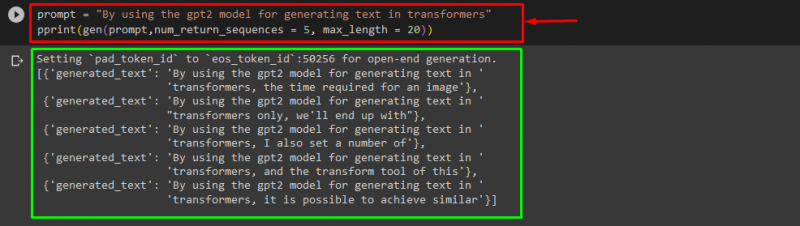

PyTorch میں ٹیکسٹ بنانے کے لیے ٹرانسفارمر پر مبنی ماڈل کا استعمال کیسے کریں؟

صارفین 'میں متن کو بھی اپنی مرضی کے مطابق بنا سکتے ہیں۔ پائی ٹارچ ' جو ہے ' ٹارچ پر مبنی مشین لرننگ فریم ورک۔ اس کا استعمال مختلف ایپلی کیشنز، جیسے کہ NLP اور کمپیوٹر ویژن کے لیے کیا جاتا ہے۔ PyTorch میں متن کو اپنی مرضی کے مطابق کرنے کے لیے ٹرانسفارمر پر مبنی ماڈل استعمال کرنے کے لیے، پہلے ' جی پی ٹی 2 ٹوکنائزر 'اور' جی پی ٹی 2 ماڈل ' سے افعال ' ٹرانسفارمرز ”:

سے ٹرانسفارمرز درآمد جی پی ٹی 2 ٹوکنائزر ، جی پی ٹی 2 ماڈلپھر، استعمال کریں ' جی پی ٹی 2 ٹوکنائزر ہمارے مطلوبہ پہلے سے تربیت یافتہ ماڈل کے مطابق ٹوکنائزر gpt2 ”:

ٹوکنائزر = جی پی ٹی 2 ٹوکنائزر۔ سے_پہلے سے تربیت یافتہ ( 'gpt2' )اس کے بعد، پہلے سے تربیت یافتہ ماڈل سے وزن کو تیز کرنا:

ماڈل = جی پی ٹی 2 ماڈل۔ سے_پہلے سے تربیت یافتہ ( 'gpt2' )اگلا، اعلان کریں ' gen_text متغیر جو متن رکھتا ہے جسے ہم اپنی مرضی کے مطابق بنانا چاہتے ہیں:

gen_text = 'ٹرانسفارمرز میں متن پیدا کرنے کے لیے gpt2 ماڈل کا استعمال کرتے ہوئے'اب، پاس کریں ' gen_text 'اور' return_tensors = 'pt' 'ایک دلیل کے طور پر جو PyTorch میں متن تیار کرے گا اور پیدا شدہ قدر کو ' encoded_input متغیر:

encoded_input = ٹوکنائزر ( gen_text , واپسی_ٹینسر = 'pt' )آخر میں، پاس کریں ' encoded_input ' متغیر جو اپنی مرضی کے مطابق متن رکھتا ہے ' ماڈل 'پیرامیٹر کے طور پر اور 'کا استعمال کرتے ہوئے نتیجہ خیز آؤٹ پٹ حاصل کریں۔ زیادہ سے زیادہ طوالت 'دلیل جو سیٹ ہے' بیس 'جو اس بات کی نشاندہی کرتا ہے کہ تیار کردہ متن فراہم کردہ ٹوکن تک محدود رہے گا، ' num_return_sequences 'جو سیٹ ہے' 5 ' جو ظاہر کرتا ہے کہ تیار کردہ متن متن کے 5 سلسلے پر انحصار کرے گا:

آؤٹ پٹ = ماڈل ( **انکوڈڈ_ان پٹ )جنریٹر ( gen_text ، زیادہ سے زیادہ طوالت = بیس , num_return_sequences = 5 )

آؤٹ پٹ

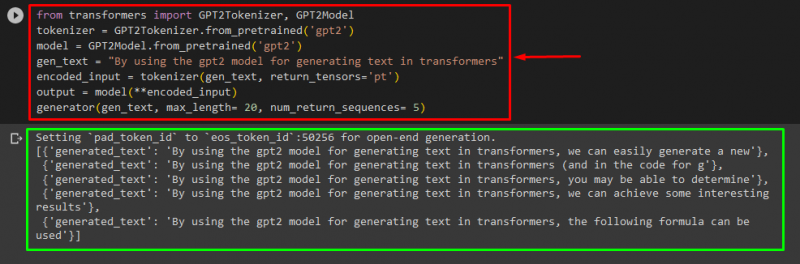

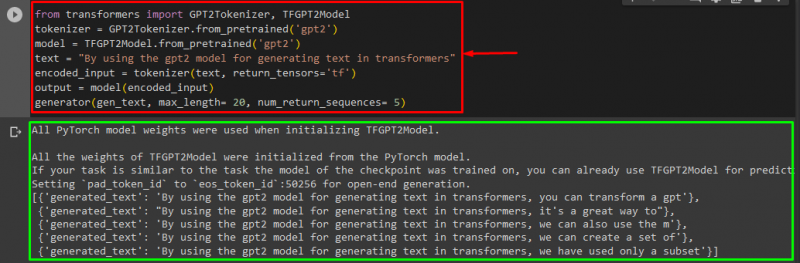

TensorFlow میں ٹیکسٹ بنانے کے لیے ٹرانسفارمر پر مبنی ماڈل کا استعمال کیسے کریں؟

ٹرانسفارمرز میں متن پیدا کرنے کے لیے، ' ٹینسر فلو پر مبنی مشین لرننگ فریم ورک بھی استعمال کیا جاتا ہے۔ ایسا کرنے کے لیے، پہلے، مطلوبہ افعال درآمد کریں، جیسے کہ ' جی پی ٹی 2 ٹوکنائزر 'اور' TFGPT2 ماڈل ' سے ' ٹرانسفارمرز ' باقی کوڈ اوپر جیسا ہی ہے، بس ہم استعمال کرتے ہیں ' TFGPT2 ماڈل 'فنکشن' کے بجائے جی پی ٹی 2 ماڈل فنکشن مندرجہ ذیل کے طور پر:

سے ٹرانسفارمرز درآمد جی پی ٹی 2 ٹوکنائزر , TFGPT2 ماڈلٹوکنائزر = جی پی ٹی 2 ٹوکنائزر۔ سے_پہلے سے تربیت یافتہ ( 'gpt2' )

ماڈل = TFGPT2 ماڈل۔ سے_پہلے سے تربیت یافتہ ( 'gpt2' )

متن = 'ٹرانسفارمرز میں متن پیدا کرنے کے لیے gpt2 ماڈل کا استعمال کرتے ہوئے'

encoded_input = ٹوکنائزر ( متن , واپسی_ٹینسر = 'tf' )

آؤٹ پٹ = ماڈل ( encoded_input )

جنریٹر ( gen_text , زیادہ سے زیادہ طوالت = بیس , num_return_sequences = 5 )

جیسا کہ آپ دیکھ سکتے ہیں، حسب ضرورت متن کامیابی کے ساتھ تیار کیا گیا ہے:

یہی ہے! ہم نے ٹرانسفارمرز میں ٹیکسٹ جنریشن کو حسب ضرورت بنانے کے بارے میں وضاحت کی ہے۔

نتیجہ

ٹرانسفارمرز میں ٹیکسٹ جنریشن کو اپنی مرضی کے مطابق بنانے کے لیے، مختلف طریقے ہیں جیسے پائپ لائن فنکشن کے ساتھ ماڈل کو لوڈ کرنا، ٹرانسفارمر پر مبنی ماڈل کا استعمال کرتے ہوئے ' پی ٹارچ 'اور' ٹینسر فلو جو مشین لرننگ فریم ورک پر مبنی ہیں۔ اس گائیڈ میں، ہم نے ٹرانسفارمرز میں ٹیکسٹ جنریشن کو حسب ضرورت بنانے کے عملی مظاہرے کے ساتھ مختصر معلومات فراہم کی ہیں۔