اس بلاگ میں، ہم PyTorch میں پہلے سے تربیت یافتہ ماڈل کو درآمد کرنے کے بارے میں دو طریقوں پر جائیں گے۔

ٹارچ ویژن کا استعمال کرتے ہوئے PyTorch میں پہلے سے تربیت یافتہ ماڈل کیسے درآمد کیا جائے؟

' ٹارچ ویژن لائبریری کو PyTorch میں پہلے سے تربیت یافتہ ماڈلز درآمد کرنے کے لیے استعمال کیا جا سکتا ہے۔ یہ پرائمری کی ایک ذیلی تقسیم ہے ' ٹارچ لائبریری اور اس میں پہلے مرتب کردہ ڈیٹاسیٹس اور تربیت یافتہ ماڈلز کی فعالیت شامل ہے۔ یہ لائبریری صارفین کو ایسے ماڈلز کو کال کرنے کی اہلیت فراہم کرتی ہے جنہیں ایک بڑے ڈیٹاسیٹ پر تربیت دی گئی ہے۔ یہ پہلے سے تربیت یافتہ ماڈلز کو نئے ڈیٹا پر لاگو کیا جا سکتا ہے اور لمبے اور غیر منظم ٹریننگ لوپس کی ضرورت کے بغیر درست نتائج فراہم کر سکتے ہیں۔

ٹارچ ویژن کا استعمال کرتے ہوئے PyTorch میں پہلے سے تربیت یافتہ ماڈل کو درآمد کرنے کا طریقہ سیکھنے کے لیے نیچے دیے گئے اقدامات پر عمل کریں:

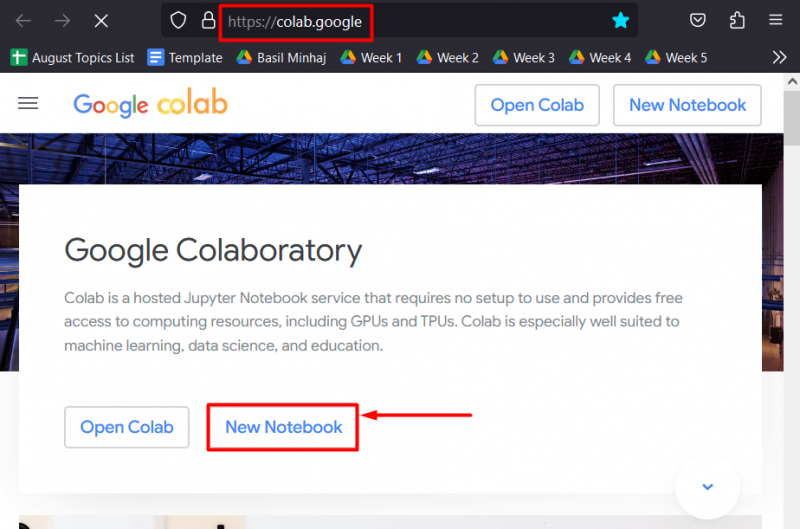

مرحلہ 1: Google Colab کھولیں۔

Colaboratory پر جائیں۔ ویب سائٹ گوگل کے ذریعہ تخلیق کیا گیا اور شروع کریں ' نئی نوٹ بک پروجیکٹ شروع کرنے کے لیے:

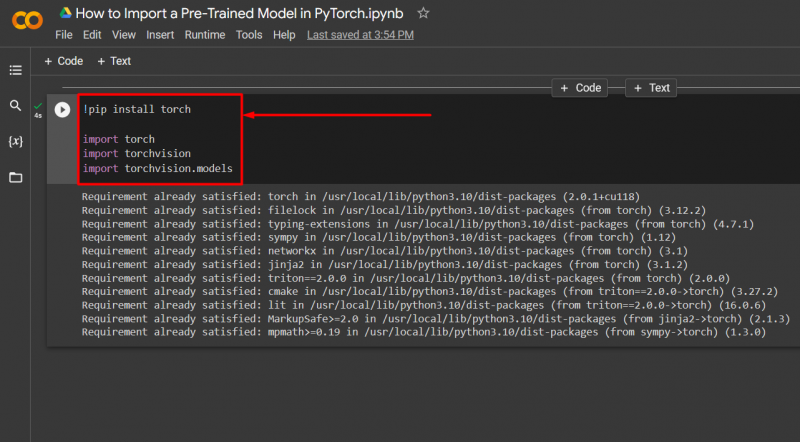

مرحلہ 2: ضروری لائبریریاں درآمد کریں۔

Colab IDE کے سیٹ اپ ہونے کے بعد، پہلا مرحلہ پروجیکٹ میں درکار لائبریریوں کو انسٹال اور درآمد کرنا ہے:

درآمد ٹارچ

درآمد ٹارچ ویژن

درآمد ٹارچ ویژن ماڈلز

مندرجہ بالا کوڈ اس طرح کام کرتا ہے:

- ' pip 'پائیتھون کے لئے پیکیج انسٹالر کو انسٹال کرنے کے لئے استعمال کیا جاتا ہے' ٹارچ ' کتب خانہ.

- اگلا، ' درآمد ” کمانڈ کا استعمال لائبریری کو کولاب پروجیکٹ میں درآمد کرنے کے لیے کیا جاتا ہے۔

- پھر ' ٹارچ ویژن لائبریری منصوبے میں درآمد کی جاتی ہے۔ اس میں ڈیٹاسیٹس اور ماڈلز کی فعالیت شامل ہے۔

- ' torchvision.model 'ماڈیول میں پہلے سے تربیت یافتہ ماڈلز کی ایک درجہ بندی ہوتی ہے جیسے کہ بقایا نیورل نیٹ ورک' ریس نیٹ ”:

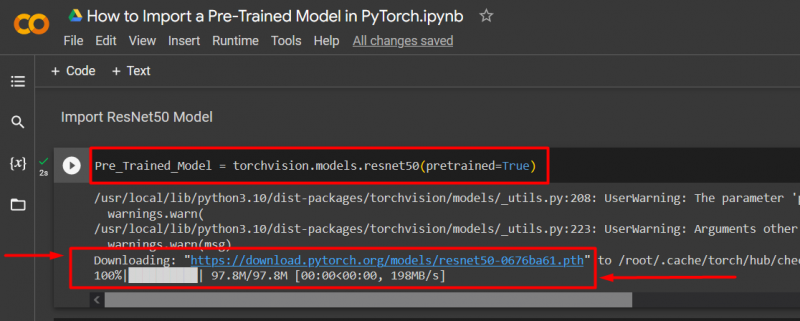

مرحلہ 3: پہلے سے تربیت یافتہ ماڈل درآمد کریں۔

نیچے دیے گئے کوڈ کا استعمال کرتے ہوئے 'torchvision.models' پیکیج میں محفوظ کردہ پہلے سے تربیت یافتہ ماڈل درآمد کریں:

مندرجہ بالا کوڈ کی لائن اس طرح کام کرتی ہے:

- متغیر کی وضاحت کریں اور اسے حوالہ کے لیے ایک مناسب نام دیں جیسے 'پری_تربیت یافتہ_ماڈل' .

- کا استعمال کرتے ہیں 'torchvision.models' شامل کرنے کے لیے ماڈیول ' ریس نیٹ 'ماڈل.

- شامل کریں ' سنجیدہ50 'ماڈل اور سیٹ کریں' پہلے سے تربیت یافتہ = سچ 'اس کی دلیل کے طور پر:

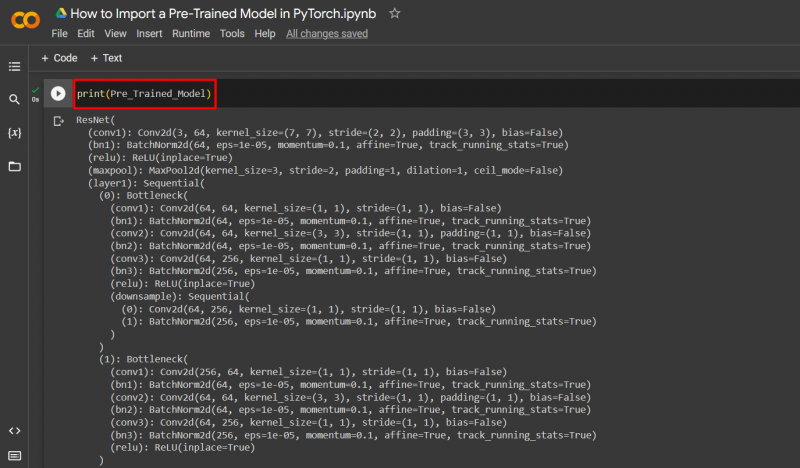

اگلا 'پرنٹ()' طریقہ استعمال کرتے ہوئے پہلے سے تربیت یافتہ ماڈل کو آؤٹ پٹ کے طور پر دیکھیں:

پرنٹ کریں ( پری_تربیت یافتہ_ماڈل )

نوٹ : آپ ہماری Colab نوٹ بک تک رسائی حاصل کر سکتے ہیں جو اس پر ٹارچ ویژن کا استعمال کرتے ہوئے پہلے سے تربیت یافتہ PyTorch ماڈل کی درآمد کی تفصیلات فراہم کرتی ہے۔ لنک .

Hugging Face Database سے پہلے سے تربیت یافتہ PyTorch ماڈل کو کیسے درآمد کیا جائے؟

پہلے سے تربیت یافتہ ماڈل کو درآمد کرنے کا دوسرا طریقہ اسے Hugging Face پلیٹ فارم سے حاصل کرنا ہے۔ Hugging Face پہلے سے تربیت یافتہ ماڈلز اور ڈیٹا سائنسدانوں اور پروگرامرز کے لیے دستیاب بڑے ڈیٹا سیٹس کے لیے مشہور آن لائن ڈیٹا بیس میں سے ایک ہے۔

Hugging Face Dataset سے پہلے سے تربیت یافتہ PyTorch ماڈل درآمد کرنے کے لیے درج ذیل مراحل پر عمل کریں:

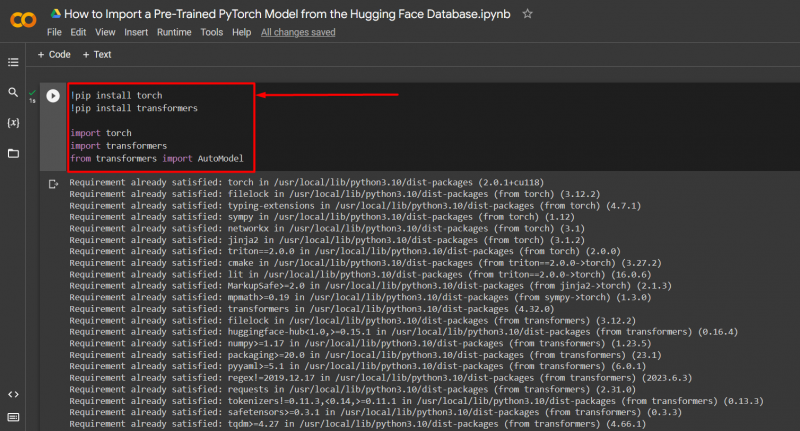

مرحلہ 1: کولاب نوٹ بک لانچ کریں اور مطلوبہ لائبریریاں انسٹال اور درآمد کریں۔

پہلا قدم یہ ہے کہ Colab IDE میں ایک نوٹ بک لانچ کریں اور 'کا استعمال کرتے ہوئے لائبریریاں انسٹال کریں۔ pip 'پیکیج انسٹالر اور ان کا استعمال کرتے ہوئے درآمد کریں' درآمد ' کمانڈ:

! پائپ انسٹال ٹرانسفارمرز

درآمد ٹارچ

درآمد ٹرانسفارمرز

ٹرانسفارمرز سے درآمد آٹو ماڈل

اس منصوبے میں درج ذیل لائبریریوں کی ضرورت ہے۔

- ' ٹارچ لائبریری ضروری PyTorch لائبریری ہے۔

- ' ٹرانسفارمرز 'لائبریری میں Hugging Face، اس کے ماڈلز، اور اس کے ڈیٹاسیٹس کی فعالیت شامل ہے:

مرحلہ 2: ہیگنگ فیس سے ماڈل درآمد کریں۔

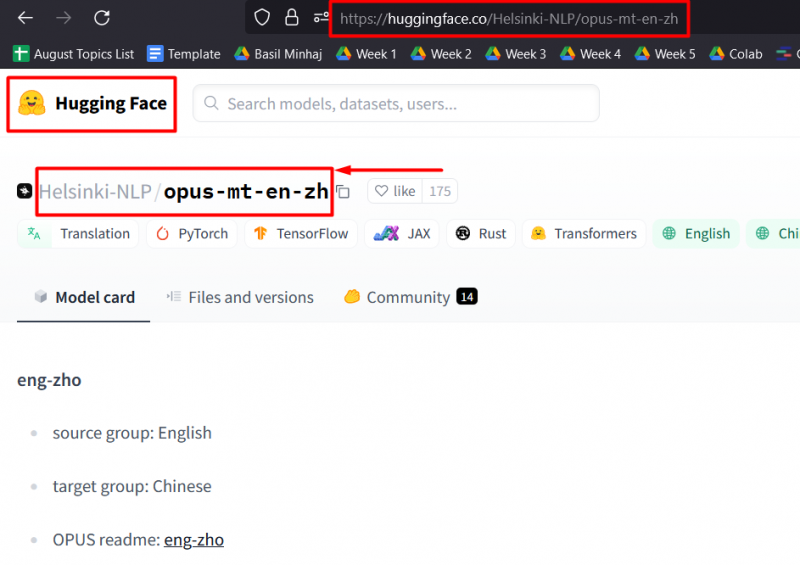

اس مثال میں، ماڈل سے درآمد کیا جانا ہے ' گلے ملنے والا چہرہ اس پر ڈیٹا بیس دستیاب ہے۔ لنک . کا استعمال کرتے ہیں ' AutoModel.from_pretrained() ہگنگ فیس سے پہلے سے تربیت یافتہ ماڈل درآمد کرنے کا طریقہ جیسا کہ ذیل میں دکھایا گیا ہے:

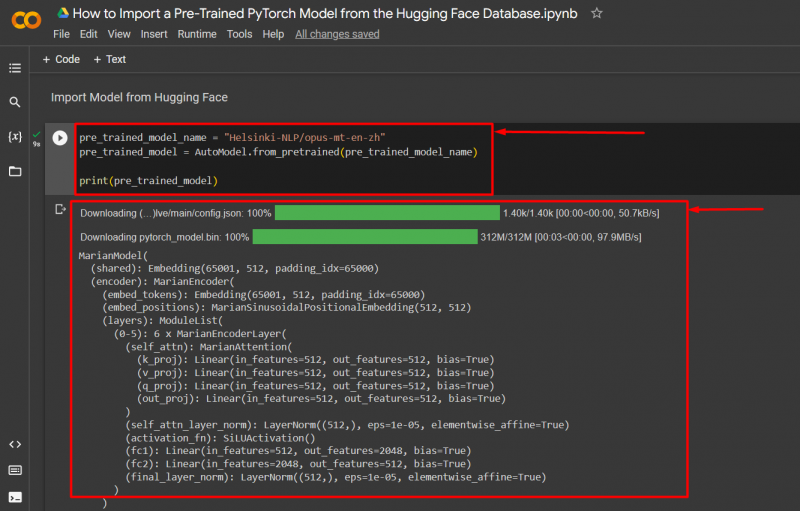

pre_trained_model = آٹو ماڈل۔ سے_پہلے سے تربیت یافتہ ( pre_trained_model_name )

پرنٹ کریں ( pre_trained_model )

مندرجہ بالا کوڈ اس طرح کام کرتا ہے:

- ہیگنگ فیس پلیٹ فارم پر اس کی ویب سائٹ سے ماڈل کا نام کاپی کریں اور اسے تفویض کریں۔ pre_trained_model_name ' Colab میں متغیر۔

- پھر، استعمال کریں ' AutoModel.from_pretrained() ” طریقہ اور ماڈل نام متغیر کو اس کی دلیل کے طور پر داخل کریں۔

- آخر میں، استعمال کریں 'پرنٹ کریں() آؤٹ پٹ میں درآمد شدہ ماڈل کو ظاہر کرنے کا طریقہ۔

Hugging Face سے درآمد شدہ پہلے سے تربیت یافتہ ماڈل درج ذیل آؤٹ پٹ دکھائے گا:

نوٹ : آپ ہماری Colab نوٹ بک تک رسائی حاصل کر سکتے ہیں جس میں بتایا گیا ہے کہ Hugging Face سے پہلے سے تربیت یافتہ ماڈل کیسے درآمد کیا جائے لنک .

پرو ٹِپ

Hugging Face بڑے ڈیٹاسیٹس اور پیچیدہ ماڈلز کا ایک قیمتی مجموعہ ہے جو گہری سیکھنے کے منصوبوں میں استعمال کرنے کے لیے سب کے لیے مفت ہے۔ آپ دوسروں کے استعمال کے لیے اپنا ڈیٹا سیٹ بھی اپ لوڈ کر سکتے ہیں اور پلیٹ فارم کو پوری دنیا کے ڈیٹا سائنسدانوں اور ڈویلپرز کے درمیان تعاون کے لیے بنایا گیا ہے۔

کامیابی! ہم نے دکھایا ہے کہ ٹارچ ویژن لائبریری کا استعمال کرکے یا ٹرانسفارمرز لائبریری کا استعمال کرتے ہوئے Hugging Face ڈیٹا بیس سے پہلے سے تربیت یافتہ PyTorch ماڈل کیسے درآمد کیا جائے۔

نتیجہ

PyTorch میں پہلے سے تربیت یافتہ ماڈل درآمد کرنے کے لیے، صارفین یا تو ٹارچ ویژن لائبریری کا استعمال کر سکتے ہیں یا گوگل کولاب میں ٹرانسفارمرز لائبریری کا استعمال کرتے ہوئے Hugging Face آن لائن ڈیٹا بیس سے۔ یہ پہلے سے تربیت یافتہ ماڈلز کا استعمال ٹریننگ میں قیمتی وقت اور ہارڈ ویئر کے وسائل کو خرچ کرنے سے بچنے کے لیے کیا جاتا ہے اور براہ راست قابل اعتبار نتائج کے لیے نئے ڈیٹا کی جانچ کرنے کے لیے جاتے ہیں۔ اس بلاگ میں، ہم نے PyTorch میں پہلے سے تربیت یافتہ ماڈلز درآمد کرنے کے دو طریقے دکھائے ہیں۔